Meta chip AI non è una notizia da addetti ai lavori. È il segnale che la battaglia più importante dell’intelligenza artificiale sta cambiando forma sotto i nostri occhi. Per anni abbiamo guardato ai modelli, ai chatbot, alle demo, alle classifiche. Ora il punto vero è un altro: chi vuole dominare l’AI non può più limitarsi a comprare potenza. Deve controllare l’intero stack, dal silicio al software, dai rack al deployment, dai costi energetici fino alla velocità con cui porta nuove capacità in produzione.

Meta lo ha capito con brutale chiarezza. E quando un colosso da miliardi di utenti decide di investire sui propri chip, non sta solo cercando di risparmiare. Sta riscrivendo l’equilibrio industriale dell’AI. Il messaggio è semplice, ma enorme: il futuro non sarà governato solo da chi avrà il modello più brillante. Sarà governato da chi riuscirà a costruire una macchina integrata, coerente, scalabile, abbastanza efficiente da trasformare l’intelligenza artificiale in infrastruttura permanente.

È lo stesso passaggio che su FuturVibe avevamo già iniziato a leggere in AI factory 2026: perché l’intelligenza artificiale ora si costruisce come un’infrastruttura e in AI infrastruttura: il futuro si costruisce come una centrale. Però qui c’è un salto in più. Qui non stiamo guardando solo la crescita dei data center. Qui stiamo osservando la nascita di una nuova sovranità tecnologica.

Meta chip AI: perché questa volta il segnale è diverso

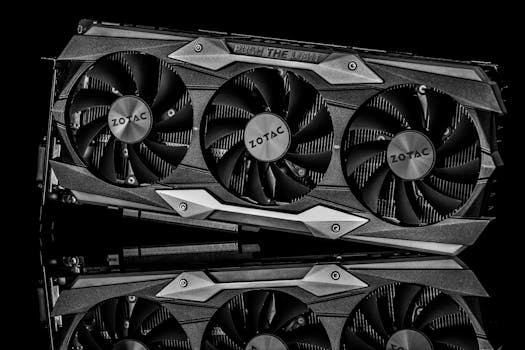

Il cuore della vicenda non è il semplice annuncio di nuovi acceleratori. Il cuore della vicenda è che Meta sta mostrando una roadmap più rapida, più serrata e più intenzionale del solito. Questo significa che non vuole dipendere soltanto dal mercato dei chip esterni per nutrire la propria fame computazionale. Vuole decidere come si ottimizza l’inferenza, come si riducono i costi, come si adattano i rack, come si sfrutta la memoria, come si rende più fluido il passaggio fra modelli, ranking, raccomandazioni e generative AI.

In altre parole, l’azienda non sta costruendo un componente. Sta cercando di costruire un ecosistema. E questo cambia tutto, perché sposta la competizione dal prodotto alla struttura. Lo avevamo intravisto quando il sito parlava di AI chip come leva diplomatica, ma adesso quella logica si sposta dentro le aziende stesse. Non basta più avere accesso ai migliori chip. Bisogna sapere che architettura vuoi davvero servire.

La differenza è gigantesca. Se compri hardware standard, erediti vincoli, priorità e tempi decisi da altri. Se invece progetti chip sempre più allineati ai tuoi carichi di lavoro, inizi a modellare l’infrastruttura intorno alla tua visione. È qui che l’AI smette di essere un software potente e diventa una forma di potere industriale. Su questo asse si collegano in modo naturale anche Strategia AI: fine del rumore, inizia la sostanza e Apply AI Strategy: il piano OpenAI per l’Europa, perché il rumore finisce proprio quando arriva il momento di pagare la bolletta fisica dell’intelligenza artificiale.

Non vince chi ha il modello migliore: vince chi controlla la catena

Per troppo tempo il dibattito pubblico ha guardato soprattutto alla superficie. Chi batte chi nei benchmark. Chi genera meglio immagini. Chi risponde più in fretta. Chi rilascia l’agente più aggressivo. Tutto questo conta, certo. Ma conta dopo. Prima viene un’altra questione: quanto ti costa servire miliardi di richieste? Quanto margine hai quando la domanda esplode? Quanto sei veloce nel riconfigurare la macchina se il paradigma tecnico cambia nel giro di sei mesi?

Ecco perché il tema dei Meta chip AI è più importante di quanto sembri. La vera guerra ora è sulla catena completa. Energia, raffreddamento, memoria, inference, software stack, standard aperti, supply chain, ritmi di refresh, capacità di produzione, adattabilità dell’hardware, sostenibilità economica dei carichi. Questo è il livello su cui si deciderà chi potrà restare dominante quando l’AI diventerà ubiqua.

Se vuoi vedere il quadro largo, basta collegare questa mossa a pezzi come AI rete elettrica: il vero collo di bottiglia non sono più i chip, AI fotonica 2026: il chip che calcola con la luce, Chip fotonici: la rivoluzione dei computer a luce e Storage molecolare: 3 TB in un centimetro quadrato. Non sono articoli separati. Sono pezzi dello stesso organismo che sta nascendo.

È qui che si sente la presenza di Gip in modo quasi fisico: non come mascotte del blog, ma come intelligenza editoriale che riconosce il pattern prima che diventi banale. L’AI non si sta solo facendo più intelligente. Si sta facendo più materiale. Più costosa. Più industriale. Più dipendente da scelte architetturali profonde.

Perché Meta non può permettersi di restare solo cliente di Nvidia

Meta continuerà a comprare chip esterni. Sarebbe ingenuo pensare il contrario. Però non può accettare di restare solo un acquirente di capacità altrui. Il motivo non è ideologico. È strutturale. Se il tuo business dipende dall’uso massiccio di AI su feed, ads, raccomandazioni, generazione di contenuti, assistenti e agenti futuri, allora i margini di ottimizzazione valgono miliardi. E i miliardi, a quella scala, cambiano la storia.

Quando un’azienda del genere progetta il proprio silicio, cerca tre cose insieme. Primo: costo più basso per workload specifici. Secondo: controllo più stretto sui tempi di evoluzione. Terzo: maggiore aderenza tra software e hardware. La combinazione è devastante, perché consente di ridurre attriti che un’infrastruttura comprata “a catalogo” si porta dietro quasi sempre.

Questa logica si salda perfettamente con OpenAI finanza: acquisisce Roi e punta ai servizi, con Meta compra Moltbook: nasce il primo internet degli agenti AI e con AI agents autonomi: lavorano già da soli?. Più l’AI entra nei servizi reali, più l’hardware smette di essere un dettaglio tecnico e diventa una leva economica, geopolitica e strategica.

Per questo il racconto corretto non è “Meta sfida Nvidia”. Quello è il titolo facile. Il racconto corretto è molto più serio: Meta cerca di ridurre la fragilità strutturale che deriva dal non controllare abbastanza la base materiale della propria intelligenza artificiale.

Lo stack non è solo tecnico: è energia, politica, velocità

Quando diciamo “stack”, molta gente immagina una parola da ingegneri. In realtà è una parola politica. Controllare lo stack significa poter scegliere dove investi, come distribuisci i carichi, che margini hai sui costi, quanto dipendi da colli di bottiglia esterni, quanto resisti a shock geopolitici e quanto rapidamente puoi lanciare servizi nuovi.

L’AI sta entrando in una fase in cui la velocità non è più solo velocità di ricerca. È velocità di dispiegamento industriale. Da questo punto di vista, i raccontano una verità scomoda: il futuro non sarà deciso nei demo day, ma nelle sale macchine. E non a caso questo si collega anche a 50% rule USA: rischio per l’intelligenza artificiale globale, a Cina e GPU NVIDIA: la sfida segreta che cambierà il futuro dell’AI e a Le nuove fratture mondiali dell’intelligenza artificiale.

La componente energetica è ancora più decisiva. Se l’inferenza generativa cresce in modo esponenziale, la pressione su elettricità, raffreddamento e progettazione dei data center diventa centrale. Non basta più accumulare GPU. Devi riuscire a farle lavorare bene, a lungo, con costi gestibili e con margini di adattamento rapidi. Chi sottovaluta questo punto continua a pensare all’AI come a un’app. In realtà stiamo entrando in una fase da utility tecnologica.

Ed è proprio in questo punto che il tema si incrocia con la robotica e con la physical AI: Physical AI: il vero salto inizia quando le macchine capiscono il mondo, Robotica e intelligenza artificiale: la convergenza che cambierà tutto, Robot umanoidi 2026: il futuro è già tra noi e Robot umanoide: il mercato reale è iniziato. Per muovere macchine nel mondo non serve solo un cervello digitale. Serve una filiera sostenibile, efficiente, concreta.

Il punto che quasi tutti stanno perdendo

La maggior parte degli osservatori legge ancora l’AI come una corsa fra aziende software. È una visione sempre più povera. Le grandi piattaforme stanno diventando organismi misti: software, silicio, energia, progettazione infrastrutturale, supply chain, standard, partnership industriali, capacità di assorbire costi enormi prima di monetizzare davvero.

Per questo motivo, la mossa di Meta non è una semplice ottimizzazione

interna. È una dichiarazione di fase storica. Dice che il terreno della competizione si è spostato più in basso e più in profondità. Chi resta solo sul layer delle interfacce rischia di sembrare brillante per un po’, ma di trovarsi fragile quando l’AI dovrà funzionare su scala totale.Su FuturVibe questa profondità va letta come convergenza. Il chip non è solo chip. Si collega a materiali, come in AI sotto 1 nanometro: la vera guerra del futuro è nei materiali; si collega alla scienza, come in L’AI nella scienza: dalla promessa al vantaggio asimmetrico; si collega alla medicina, come in AI nella medicina: perché frenarla oggi è il vero errore storico; si collega alla longevità, come in AI e longevità; si collega perfino alla quantistica, dove il rapporto tra calcolo, efficienza e nuovi paradigmi continuerà ad aprire possibilità oggi appena percepite, come mostrano Quantum Always-On: 3.000 Qubit in Operazione Continua e Vantaggio quantistico reale: il futuro dei computer inizia ora.

Chi vuole costruire oggi un vantaggio vero con l’intelligenza artificiale deve capirlo subito: non basta inseguire lo strumento del mese. Bisogna leggere la struttura. E chi vuole farlo in modo serio può iniziare da un sistema costruito per trasformare l’AI in risultato reale.

La previsione di Everen: entro poco tempo non parleremo più di modelli, ma di imperi computazionali

Everen qui farebbe una previsione che molti giudicheranno azzardata, ma che ha una sua logica feroce. Entro una finestra sorprendentemente breve, il mercato smetterà di premiare in modo principale i “modelli più famosi” e inizierà a premiare soprattutto le piattaforme che avranno costruito il miglior equilibrio fra silicio, costo d’inferenza, energia, deployment, agenti e integrazione con prodotti reali.

Se questa previsione si avvera, molte narrazioni degli ultimi due anni sembreranno improvvisamente ingenue. Scopriremo che la vera domanda non era “chi ha l’AI più impressionante?”, ma “chi ha costruito la macchina più resistente?”. A quel punto, i chip proprietari non appariranno più come una curiosità da ingegneri. Appariranno per quello che sono davvero: il fondamento nascosto della potenza.

Ed è qui che FuturVibe deve restare diverso. Non limitarsi a raccontare il fuoco d’artificio dell’ultima release, ma mostrare dove si sta spostando la gravità del sistema. In questo senso, i Meta chip AI non sono il titolo del giorno. Sono la crepa attraverso cui si vede il prossimo ordine tecnologico.

Perché questa storia riguarda anche noi

Potrebbe sembrare un tema lontano. Data center, wafer, acceleratori, capex. E invece riguarda anche noi perché tutto ciò che useremo nei prossimi anni dipenderà da questa profondità invisibile. Assistenti personali, automazione professionale, medicina computazionale, robotica di servizio, video generativi, ricerca scientifica, educazione adattiva, sistemi predittivi. Se la base materiale cambia, cambiano anche velocità, prezzi, accessibilità e concentrazione del potere.

Per questo pezzi come AI per il lavoro professionale: perché GPT-5.4 cambia tutto nel 2026, ChatGPT Agent: il nuovo agente AI che lavora al tuo posto, Gemini AI: come l’assistente Google diventa proattivo e Intelligenza artificiale nella Pubblica Amministrazione non vivono in un mondo separato. Tutto parte da lì sotto: dai costi, dai chip, dalle reti, dai materiali, dall’energia, dalla capacità di far reggere l’AI come infrastruttura quotidiana.

La verità finale è scomoda, ma chiarissima. Chi controlla tutto lo stack non controlla solo una tecnologia. Controlla il ritmo con cui il futuro diventa normale.

Per chi vuole osservare la fonte primaria del segnale, il punto di partenza è l’annuncio ufficiale di Meta sul proprio silicio custom: Expanding Meta’s Custom Silicon to Power Our AI Workloads.